22 | 朴素贝叶斯:如何让计算机学会自动分类?

该思维导图由 AI 生成,仅供参考

- 深入了解

- 翻译

- 解释

- 总结

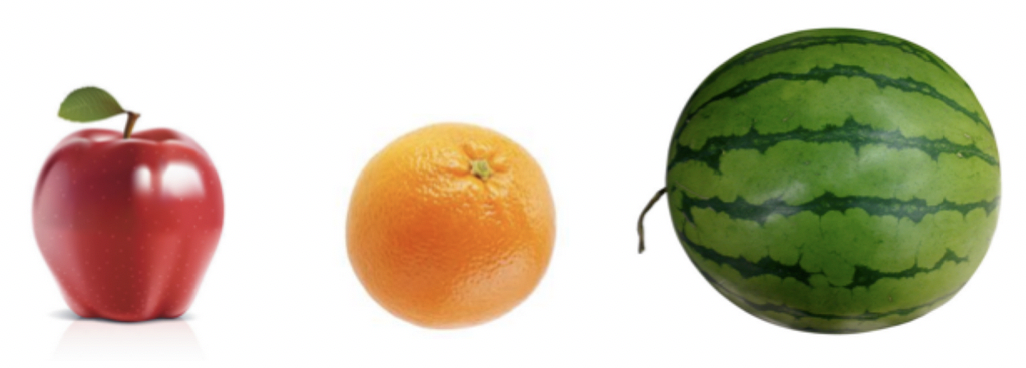

朴素贝叶斯分类是一种基于概率的机器学习方法,通过统计训练样本中各类别的先验概率和属性的条件概率,实现对新数据的分类。本文以水果分类为例,生动地解释了朴素贝叶斯分类的核心思想和实现步骤。作者首先介绍了将原始信息转化为计算机可理解的数据的过程,包括提取属性并转化为数字。然后详细讲解了朴素贝叶斯的核心思想,包括先验概率、后验概率、条件概率和贝叶斯法则。接着,作者解释了朴素贝叶斯的核心假设,即属性之间相互独立,以及如何通过统计训练样本建立朴素贝叶斯模型。最后,通过实例演示了如何利用建立的模型对新数据进行分类。文章通俗易懂,深入浅出地介绍了朴素贝叶斯分类的原理和实现过程,适合初学者快速了解该技术。此外,文章还对朴素贝叶斯与其他常见分类算法进行了比较,指出了朴素贝叶斯在离散属性值、模糊分类和快速可靠的实时分类方面的优势。文章内容丰富,涵盖了理论推导和实际应用,为读者提供了全面的了解朴素贝叶斯分类的机会。

《程序员的数学基础课》,新⼈⾸单¥68

全部留言(46)

- 最新

- 精选

山中清泉明月照p(c|f1,f2)=p(c|f1)*p(c|f2)/p(c) 应该是这样子吧

山中清泉明月照p(c|f1,f2)=p(c|f1)*p(c|f2)/p(c) 应该是这样子吧作者回复: 严格来说,应该这样推导 p(c|f1,f2)=p(c,f1,f2)/p(f1,f2)=p(c)*p(f1|c)*p(f2|f1,c)/p(f1,f2) 由于朴素贝叶斯中的马尔科夫假设,f1和f2独立,p(c)*p(f1|c)*p(f2|f1,c)=p(c)*p(f1|c)*p(f2|c),而p(f1,f2)=p(f1)*p(f2),所以p(c)*p(f1|c)*p(f2|f1,c)/p(f1,f2) = p(c)*p(f1|c)*p(f2|c)/(p(f1)*p(f2))

2019-07-07817 Bora.Don感觉老师讲得特别好,谢谢老师!同时还在极客上购买了人工智能和数据分析的课程,都讲了朴素贝叶斯,在这讲得最明白

Bora.Don感觉老师讲得特别好,谢谢老师!同时还在极客上购买了人工智能和数据分析的课程,都讲了朴素贝叶斯,在这讲得最明白作者回复: 感谢支持🙏

2019-03-02214 机智的捞球布请问老师: P(c|fi)的值不也是可以直接从训练样本中统计出来的么,为什么要用贝叶斯定理转换成p(fi|c) * p(c) / p(fi), 用另外三个统计值计算出来呢。

机智的捞球布请问老师: P(c|fi)的值不也是可以直接从训练样本中统计出来的么,为什么要用贝叶斯定理转换成p(fi|c) * p(c) / p(fi), 用另外三个统计值计算出来呢。作者回复: 这是一个非常好的问题。确实从实现的角度来说,我们也可以直接统计p(c|fi),不过这需要一些额外的数据结构,例如类似搜索引擎的倒排索引,以及对应的预处理。这会引入一些额外的空间和实际复杂度开销,特别是在大规模并行处理的时候,更加复杂一点。

2019-06-02512 唯她命朴素贝叶斯 必须各个特征相互独立的吗?

唯她命朴素贝叶斯 必须各个特征相互独立的吗?作者回复: 是的,朴素贝叶斯的“朴素”或者说naive就是指这个“天真”的假设。当然,很多时候并不成立,我们可以使用多阶马尔科夫模型来稍作修改,后面几节会有介绍。

2019-02-169 邓艺晋_Jim为何三个概率加起来不是等于1,新来的水果不是苹果就是橙子或者西瓜啊,另外想问极客的机器学习课程在哪里有,谢谢

邓艺晋_Jim为何三个概率加起来不是等于1,新来的水果不是苹果就是橙子或者西瓜啊,另外想问极客的机器学习课程在哪里有,谢谢作者回复: 需要把三个概率再归一化,因为这个概率都只是近似值,是根据贝叶斯规则推算的,所以不是真实的概率,只是一个推算值,看相对大小。 另外,极客时间里有机器学习的课程,你可以看看专栏或者视频课程的列表

2019-03-2548- 201200986终于明白朴素贝叶斯在分类中的原理了,给定的训练集其实包含训练集中每个类别的概率 每个特征的概率以及在已知类别下特征的条件概率,最终可以利用贝叶斯求得在给定特征下类别的概率,从而根据特征求得其属于哪个分类。不知道我这个理解对不对?

作者回复: 是的👍

2020-03-226  temool越看到后面越吃力,前面的也要再重新捋一遍

temool越看到后面越吃力,前面的也要再重新捋一遍作者回复: 反复阅读和练习,就能加深印象,加油!

2019-02-116 A君哦log原来是用于将计算机无法处理的小数转成绝对值大于1的数

A君哦log原来是用于将计算机无法处理的小数转成绝对值大于1的数作者回复: 是的

2020-06-273 oillie垃圾邮件可以用贝叶斯分类

oillie垃圾邮件可以用贝叶斯分类作者回复: 确实是

2020-02-032 刘清斌老师,这一讲真的很清楚明白,比其他的书籍和教程讲的形象和容易理解

刘清斌老师,这一讲真的很清楚明白,比其他的书籍和教程讲的形象和容易理解作者回复: 感谢支持!

2019-10-282