三步骤,带你快速落地多模态大模型

赵帅

本文作者结合自身在金融、家居、汽车等领域的十年实践经验,通过具体案例阐明多模态技术如何驱动 AI 落地并解决实际问题。

00:00 / 00:00

1.0x

- 3.0x

- 2.5x

- 2.0x

- 1.5x

- 1.25x

- 1.0x

- 0.75x

- 0.5x

你好,我是赵帅。

我们先来谈一谈多模态这部分。因为可能很多工程师、很多朋友,目前还没有真正进入到多模态大模型这个领域。比如有些同学在学生时代的专业不是 AI 方向,或者现在工作中还没有做到算法岗,即便是做算法的同学,可能也还停留在单模态任务,没有跨入多模态,甚至是跨模态这样的领域。所以在工程落地方面可能多少会在多模态方面存在一些短板。

为此,我会先基于多模态大模型做一个概览式的介绍,主要涵盖多模态大模型的发展现状和整体脉络。至于历史沿革、基础概念这些,由于时间有限,我就不过多展开了。同时,我也会结合我个人在多模态方面的经历、实践经验,包括实际踩过的一些坑和取得的一些成果,在这里跟大家做详细的分享,这个过程中也会穿插着我实际使用多模态技术的具体场景案例。

那我们进入正题:关于多模态大模型时代的到来。这个“时代到来”该怎么理解呢?是即将到来,还是已经到来?我认为两者皆是,它处于一个“正在到来”的过程中。回顾一下,大概在 2015 年、2016 年左右,那时被称为“大数据时代”的爆发元年,很多公司开始大规模收集数据,那是大数据时代的起点。而发展至今,大数据时代逐步过渡为“大模型时代”,最初更多集中在文本模态,之后逐渐扩展到图像、音频等其他模态,并实现跨模态交互,也就是进入了“多模态”阶段。

目前可以说,多模态时代已经迈入门槛,正在朝着更成熟、更健全、更具鲁棒性、泛化能力和安全性的方向演进,各方面能力都在不断补足短板,整体处于逐步完善的过程中。最终,多模态大模型的发展方向之一,就是朝着构建所谓的“世界模型”演进,这也是一个长远目标。

所以大家可以理解为,当前我们正处在从“大数据时代”到“大模型时代”,再进一步向“多模态时代”推进的过程中。毫不夸张地说,理解多模态本质上就是理解未来 AI 领域发展的整体思路——因为你要理解多模态,就必须先理解其中包含的各种单模态,如图像、文本、音频、传感器信号等,进而掌握它们之间的跨模态交互机制。

接下来,我将结合我个人在最近十年左右亲身参与的几个行业的经历,从更宏观的行业视角来谈一谈多模态大模型时代的发展脉络。

首先,我在金融领域做过一些 AI 相关的项目,这个领域通常被称为 FinTech,也就是金融科技。我们当时做的主要业务是个人小额贷款。流程大致是这样的:申请人提交个人信息材料给银行审核,银行为了评估贷款额度和风险,需要核实资料的真实性和申请人的背景。这个业务的传统模式是靠人工打电话做回访核实。但后来,随着人工成本越来越高,我们合作的农商行也开始技术升级,转向用 AI 打电话自动完成这个流程。

我当时是整个项目的负责人,项目从 0 到 1 落地,一期大概用了 8 到 10 个月,后面还有二期。从技术角度看,这里面就涉及到了多模态处理,包括文本和语音。因为我们是主动外呼给用户,电话这边用 TTS(语音合成)把问题用机器人的声音播出来,比如开头会说:“您好,请问您是某某先生 / 女士吗?” 可能不少人都接到过类似的机器人电话,不过我们是以银行身份打给贷款申请人做审核的。开头一般会先做身份确认,比如让用户报身份证后四位之类的。

之后就会进入正式的审核问题环节。作为外呼方,对话是由我们引导的。虽然问题本身是文本,但却是通过电话以语音形式交互。同时,用户回答的语音,我们要通过 ASR(语音识别)转成文本信号。整个过程是全双工的实时交互,技术上就涉及 TTS、NLP、ASR 等多个模块。

后来我们发现,技术虽然不断迭代,但真正落地产生价值,还得考虑人为因素的影响。比如在二期工程中,我们就遇到一个新问题:有些银行大堂经理为了帮申请人成功申贷、自己拿到佣金,会协助他们“优化”资料,甚至提前提示他们如何接听回访电话,有的还会坐在旁边小声提示申请人。

虽然人工复听时能听到这些细微的提示音,但当时的 ASR 系统识别不出来。所以我们又在二期加入了声纹识别技术,确保接电话的是申请人本人,我们便在申贷环节会提前采集用户声纹,做后续的比对验证。

那么,从技术角度来说,多模态在原有 TTS 和 ASR 的基础上又加入了声纹识别,这样就从技术上屏蔽了部分人为干预业务的情况,实现了提升。从这个案例可以看出,至少在金融科技领域,多模态已从早期的语音、文本,逐步扩展到声纹乃至图像采集。整体上,业务方向是让机器不断复刻人类的工作能力,其模式正是通过多模态模拟人类的多感官,借助客观世界的多种模态数据,实现业务闭环和泛化能力的增强。

后来我去了家居行业,也就是红星美凯龙,它属于家居零售领域。我们主要在爱琴海和红星美凯龙商场里部署机器人。最初的机器人是桶状的扫地或清理机器人,后来有了人形机器人。一开始机器人配备激光雷达等传感器,用于扫描商场路径、自动导航,既能自主打扫,也能为顾客提供指引,比如回答“女装在几楼”“烤肉店怎么走”等问题。

初期只有激光雷达和触摸屏交互,触摸屏靠感应电压实现简单互动。后来逐步增加了语音、文本等多模态方式,比如添加通话功能,机器人的“眼睛”装上摄像头,麦克风能定向收声。商场人多时,尤其小孩围上来七嘴八舌,机器人要通过视觉锁定说话人,实现交互。从单模态的传感器、触摸屏,到加入声音、文本(虽然文本输入在商场不实用),可以看出以家居零售代表的实体机器人行业,也必然朝多模态方向发展。因为单一模态有瓶颈,比如语音在嘈杂大厅中 ASR 容易误识别,需结合屏幕菜单交互,通过层级选择(如选 A→A1→A2)来弥补文本输入的不足。

之后我又进入了制造业,也就是极氪汽车。极氪是吉利汽车旗下新创的品牌,初期车辆智能化程度低,大多是采用供应商的方案,后来逐步转向自研。如果你体验过极氪汽车中控屏的“嗨,伊娃”语音助手,这个就是我们团队开发的,我负责 NLP 部分,与 CV 团队合作实现多模态。车载多模态环境比商场好很多,因为车内是封闭空间,最多五人,且彼此熟悉,不易抢话,ASR 收音效果大大提升。声纹识别也能区分车主,比如男女主人指令对应不同歌单。可见,制造业的智能化也离不开多模态。

从我近十年在金融、家居、汽车三个领域的经历看,多模态无疑是 AI 的发展趋势。大数据时代沉淀多年后,企业数据不再限于 MySQL、Oracle 等结构化数据,而是积累多种模态数据。多模态大模型时代已到来,并正走向成熟。无论企业或个人开发者,要想做大做强,最终都是要朝多模态方向发展的。

从国内开源模型看,如 DeepSeek、通义千问、GLM,它们从起步到现在,可以发现版本迭代规律是先做好大模型基座,再衍生多模态版,中间穿插语音、代码等分支。例如 DeepSeek 从代码模型起步,后推出多模态 VL 版;千问和 GLM 也是类似。这说明大厂也认为多模态是发展趋势,因为纯文本无法满足需求。

多模态的典型应用很广。个人场景如微信(文本 + 语音)、淘宝 / 百度(图像搜索)、抖音(视频 + 文本)、高德 / 美团(文本 + 传感器定位)、手机助手(语音 + 传感器)等。企业场景包括智驾、客服、医疗、教育等。可以说,任何应用都含多模态,任何场景都可用大模型助力,结合点就是多模态大模型。但这样说太宽泛,从战略层可抽象为四个层面:感知层(将数据语言化)、理解层(多模态数据语义对齐)、决策层(AI 具备因果感知,行为符合现实)、生成层(动作投影回现实)。所有多模态智能体都离不开这四层。

技术底座上,多模态融合流程大致分四步:Embedding(数据向量化)、对齐(不同模态单位统一,如文本 - 字、图像 - 像素、音频 - 光谱)、融合(模态间深度交互)、解码(输出所需形式)。主流架构有三种:双塔结构(如 CLIP)、融合解码(如 BLIP)、统一 Transformer(所有模态 Token 一起处理,如 GPT 系列)。

多模态的难点不在模态,而在语义对齐。一是数据对齐难:模态单位天生不同,需人工标注,但人为主观性导致不一致。比如同一图片有人标“举伞行走”,有人标“雨中行人”,描述上的差异就会影响训练。二是算力开销高:Transformer 的自注意力复杂度随 Token 数以平方级别增长,多模态使 Token 暴增,推理时 KV 缓存扩大,延迟和通讯成本上升,经济压力也大。

另外,优化冲突也是多模态的一个难点。要想让多模态效果做好,很难做到“既要又要”,肯定需要在模态权重上做一些取舍。比如视频或图像的清晰度不是越高越好,文本的深度思考也不是越长越好,都需要权衡。优化目标的冲突包括模态权重的冲突(不同模态如何平衡)、局部和全局的冲突等。

接下来,我们看多模态大模型如何训练,包括从 0 到 1 的预训练(Pre-training)和后续的调优(Post-training)。预训练是从零开始,用数据、算力和算法训练模型;调优则包括 P-Tuning、Lora、QLora 等方法,属于微调阶段。以 ChatGPT(GPT-3.5)为例,它的训练框架大致是:先预训练,然后做有监督微调(SFT),让人工标注问答对,让模型学习更符合人类期望的回答方式。之后为了节省人力,会训练奖励模型,通过强化学习让模型自我优化。多模态模型的训练也基于类似框架,但后续有改进,比如用 AI 生成问答对并自我纠偏。

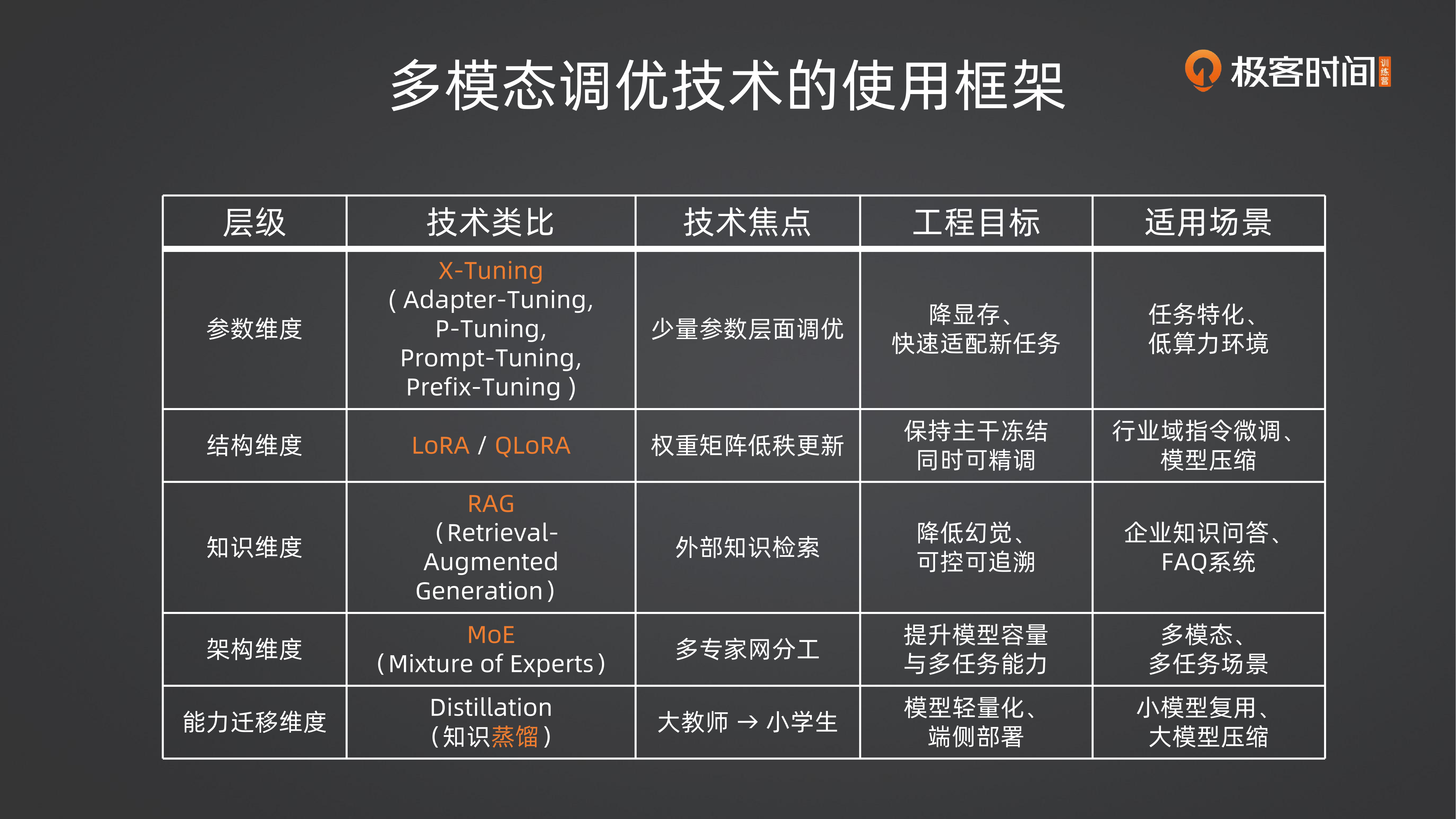

调优技术大致分五个层次:

一是 X-Tuning(如 Adapter tuning、P-tuning 等);

二是 LoRA 或 QLoRA;

三是 RAG(检索增强生成),它轻量、部署快,能减少幻觉;

四是加入 MoE 架构;

五是量化、蒸馏等加速推理的技术。

这些无论对大模型还是多模态模型都适用。

那我们接下来用一个实际的案例演示一下。案例的主题是“拍照找同款 + 智能客服问答”。数据集来自 Kaggle 平台,是一个时尚产品图像集,包含图片和描述产品信息的 CSV 文件。图片像素较低,但适合演示。数据集解压后有两个文件夹:Images(图片)和 styles.csv(产品描述)。我们需要将图片和文本关联起来做训练。但原数据没有直接文本描述,所以我写了一个脚本,根据 CSV 中的信息(如产品名称、类别)自动生成描述句(caption)。运行脚本后,会生成一个 caption.csv 的文件,用于后续训练。

我们打开生成的 CSV 文件看一下,里面有两列:ID 和 caption(描述文本)。caption 是通过脚本基于 styles.csv 中的数据字典拼接生成的,ID 则直接取自 styles.csv 中的 ID 字段,用于后续的对齐操作。

接下来进入实战部分,也就是“拍照找同款 + 智能客服”的功能。我们使用 CLIP 模型来实现。由于时间有限,CLIP 的原理细节这里不展开,感兴趣的同学可以提前了解,在多模态大模型训练营课程第三周也会系统讲解。

CLIP 是一个预训练模型,使用时需要加载权重文件。程序会先检查本地是否有权重,如果没有则会自动从 Hugging Face 下载指定版本的 CLIP 模型(约 605MB)。下载完成后,程序会生成索引文件以便后续检索。

我们执行 Python 脚本,通过文字提示搜索图片。例如输入:

模型会加载本地权重,并默认返回相似度最高的 5 个结果。我们查看排名第一的图片,ID 为 13494,对应 Images 文件夹中的 13494.jpg。搜索结果显示,模型成功根据“夏季白色 T 恤”这一文本找到了匹配的图片。系统还会返回每个结果的相似度分数,支持文搜图、图搜图、多图检索,以及图文混合搜索等模式。若新增图片,需重新构建索引。

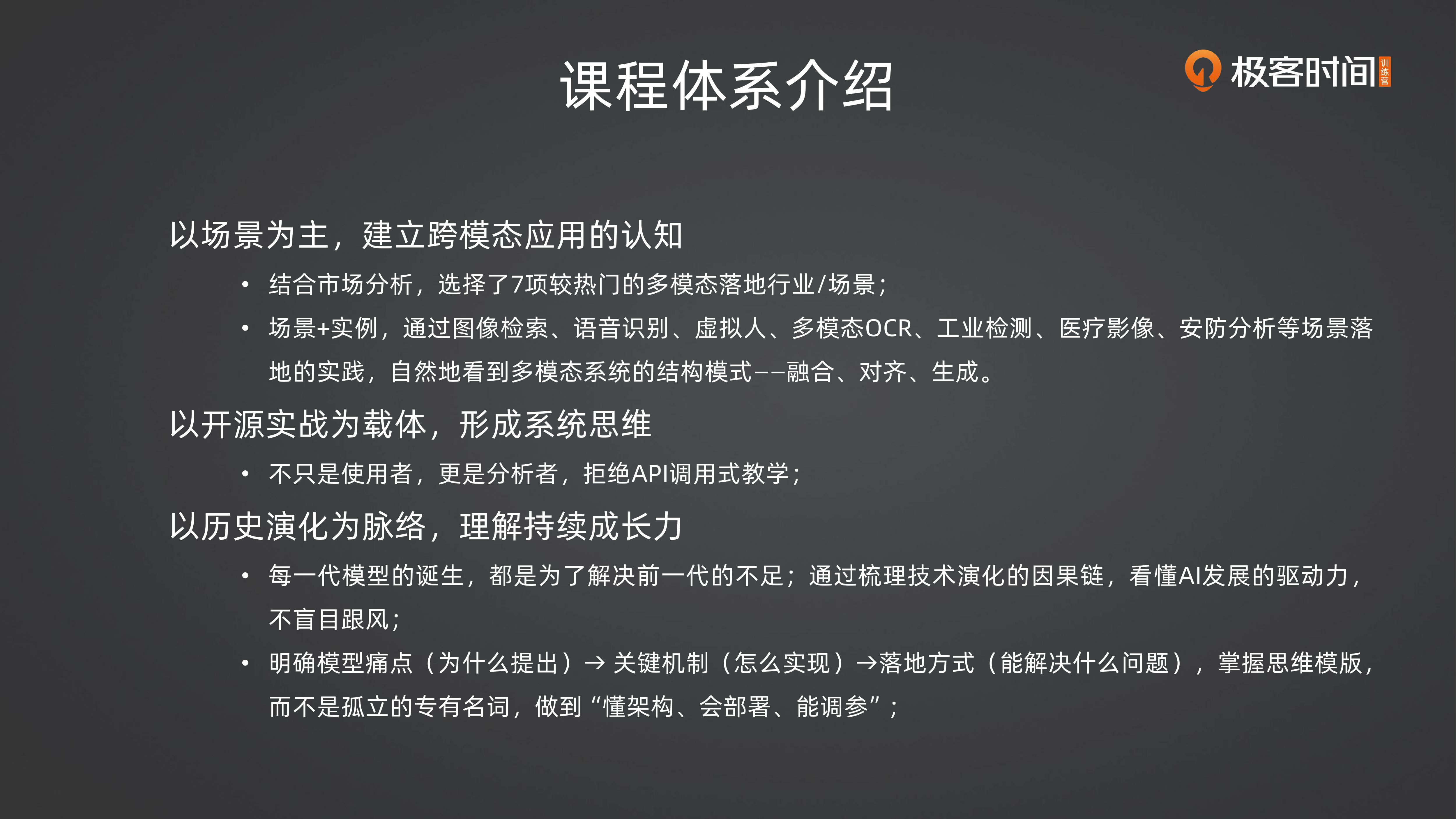

最后简要介绍多模态大模型训练营的课程设计思路。我们以场景驱动为主,结合对招聘市场和行业趋势的分析,选取了 7 个热门的多模态落地场景,覆盖金融、快消、医疗等不同行业背景的用户。课程围绕实际场景与开源模型展开,注重动手实践,帮助大家从底层理解技术,无论是自主部署还是与供应商沟通,都能心中有数。

课程以技术演进为脉络,讲解每一代模型解决的痛点与关键机制,培养大家系统性的技术判断力,避免被片面信息误导。学习方法上,我也强调要明确概念定义、理解历史演变、认清技术边界。例如,不能把普通自动化称为“Agent”,也不能滥用“AIGC+ 多模态”等术语。学完后,希望大家即使当前项目未使用多模态,也能具备宏观视野,为未来技术迭代预留思路。

整体来说,我们的学习路径是要先精通一种技术,再触类旁通,最终融会贯通。我用一个算术方面的例子可能更方便大家理解,比如快速计算 4862×5 的方法,是理解“乘 5 等于先除 2 再乘 10”的通用规律。掌握本质,方能举一反三,这也是本课程希望传递给大家的学习方法。

公开

同步至部落

取消

完成

0/2000

笔记

复制

AI

- 深入了解

- 翻译

- 解释

- 总结

1. 多模态大模型的发展现状和整体脉络,包括其从大数据时代过渡为大模型时代,以及逐步扩展到图像、音频等其他模态,并实现跨模态交互。 2. 多模态时代已经迈入门槛,正在朝着更成熟、更健全、更具鲁棒性、泛化能力和安全性的方向演进,各方面能力都在不断补足短板,整体处于逐步完善的过程中。 3. 多模态大模型的发展方向之一是朝着构建所谓的“世界模型”演进,这也是一个长远目标。

2025-12-16给文章提建议

仅可试看部分内容,如需阅读全部内容,请付费购买文章所属专栏

《极客时间 VIP · 干货直播稿精选》

《极客时间 VIP · 干货直播稿精选》

立即购买

© 版权归极客邦科技所有,未经许可不得传播售卖。 页面已增加防盗追踪,如有侵权极客邦将依法追究其法律责任。

登录 后留言

精选留言

由作者筛选后的优质留言将会公开显示,欢迎踊跃留言。

收起评论