面壁智能低调开源大模型“理科状元”!LeetCode 周赛超越80%人类选手,推理性能超 Llama3-70B

褚杏娟

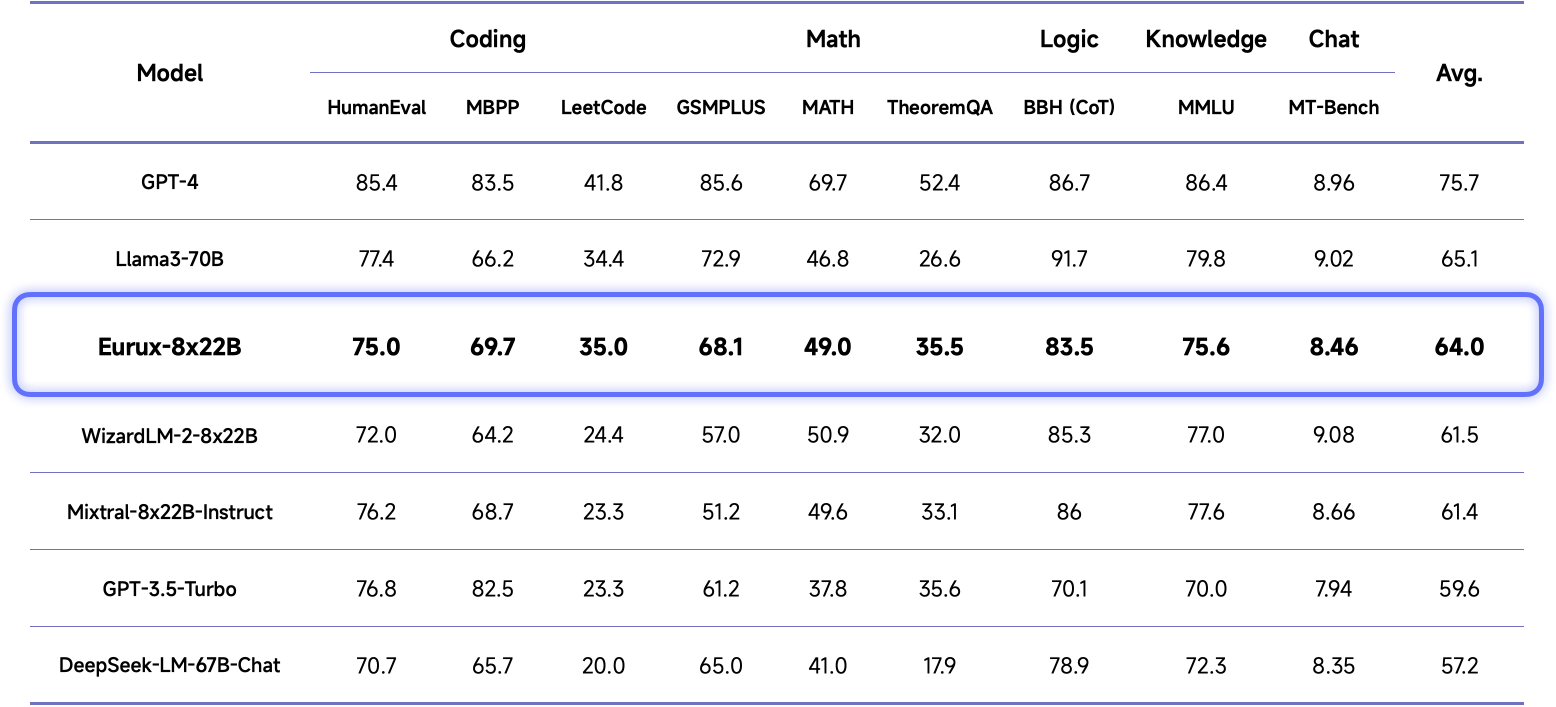

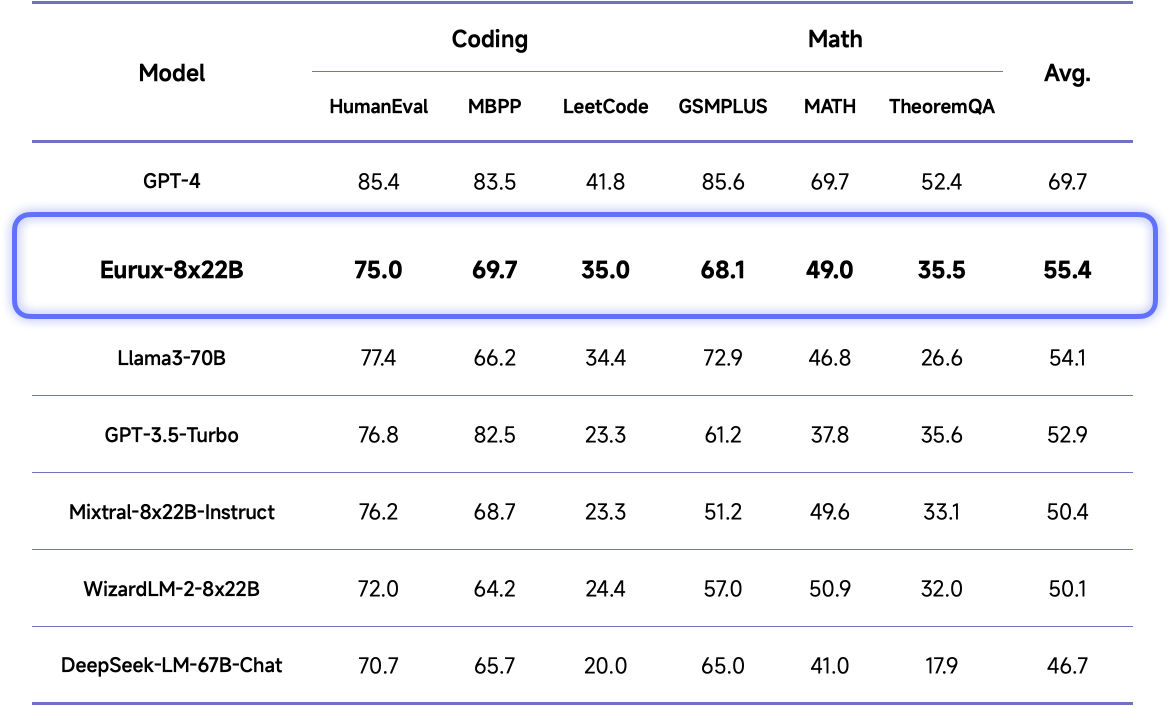

在 4 月 18 日 Llama3 发布前两天,面壁智能低调开源了大模型 Eurux-8x22B。据悉,该模型在代码和数学等体现大模型核心素质的复杂推理综合性能方面超越 Llama3-70B,刷新开源大模型 SOTA,堪称“理科状元”。

除了开源时间早于 LlaMa3,Eurux-8x22B 的激活参数仅有 39B,推理速度更快,目前支持 64k 上下文,相比之下 Llama3-70B 的上下文大小为 8K。

此外,Eurux-8x22B 由 Mistral-8x22B 对齐而来,综合性能不输 Llama3-70B。

Eurux-8x22B 模型和对齐数据,全家桶开源:

LeetCode 周赛超越 80% 的人类选手

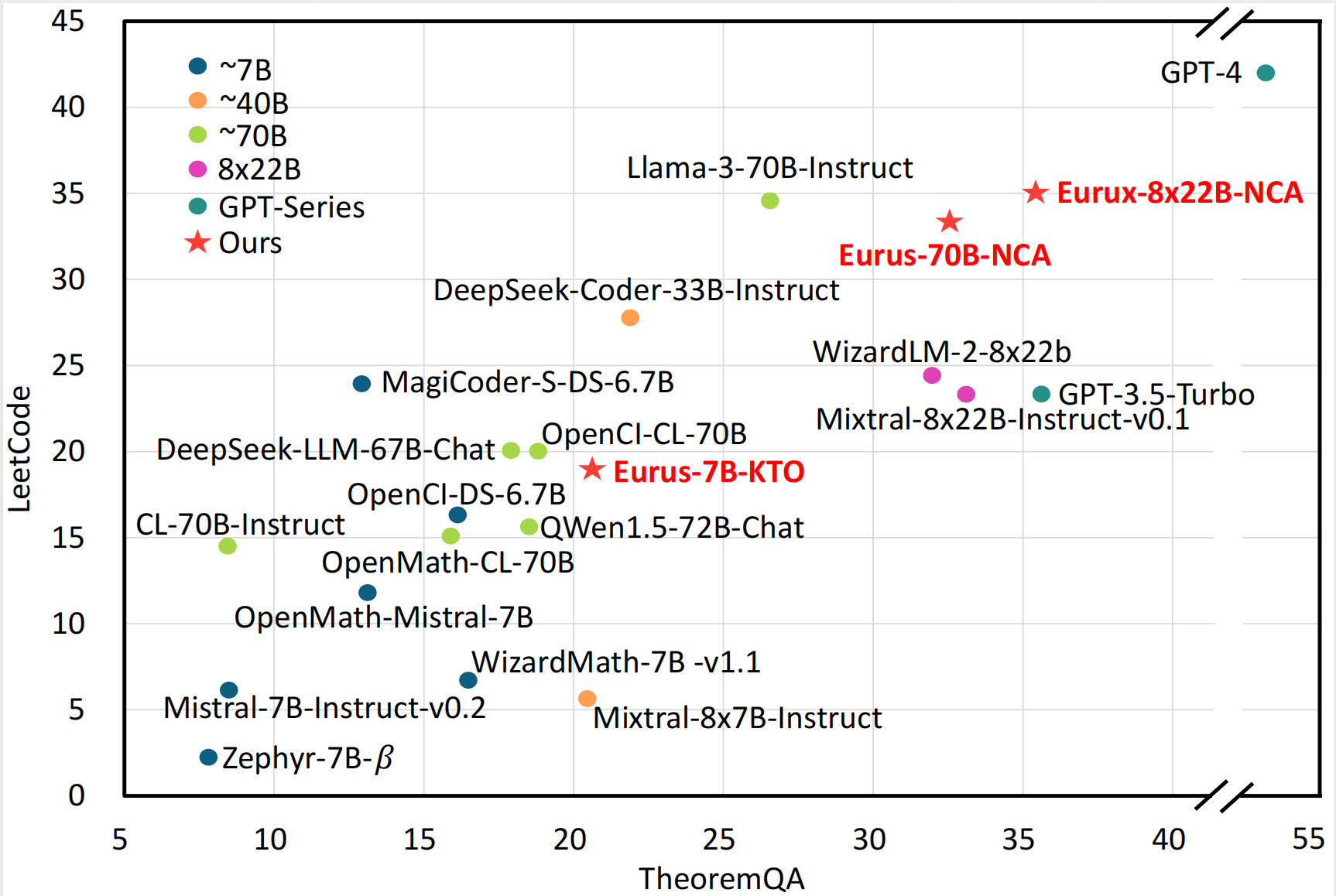

复杂推理能力是体现大模型性能差异的最核心能力之一,也是大模型真正落地应用所需的关键能力所在。根据测评,Eurux-8x22B 在代码和数学等复杂推理的综合性能方面刷新开源大模型 SOTA。

具体而言,Eurux-8x22B 在 LeetCode (180 道 LeetCode 编程真题)和 TheoremQA(美国大学水准的 STEM 题目)这两个具有挑战性的基准测试中,超过现有开源模型。

公开

同步至部落

取消

完成

0/2000

笔记

复制

AI

- 深入了解

- 翻译

- 解释

- 总结

1. 面壁智能低调开源了大模型 Eurux-8x22B,在复杂推理综合性能方面超越 Llama3-70B,刷新开源大模型 SOTA,堪称“理科状元”。 2. Eurux-8x22B 在 LeetCode 周赛中超越80%的人类选手,展现出优秀的编程和数学解题能力。 3. 面壁智能团队通过 UltraInteract 数据集和偏好对齐技术提升了大模型的推理能力,取得了令人惊艳的成绩。 4. UltraInteract 数据集包含大规模、高质量的对齐数据,通过严格质量控制和筛选,逐步推理以及多轮交互等方式构建高质量的对齐数据。 5. 面壁智能团队的开源精神将惠及所有人,未来将持续开源高效大模型及其数据集。

该试读文章来自《AI 前线》,如需阅读全部文章,

请先领取课程

请先领取课程

免费领取

© 版权归极客邦科技所有,未经许可不得传播售卖。 页面已增加防盗追踪,如有侵权极客邦将依法追究其法律责任。

登录 后留言

精选留言

由作者筛选后的优质留言将会公开显示,欢迎踊跃留言。

收起评论