马斯克履约开源Grok,超越Llama成全球最大开源模型,却被怀疑是作秀?!

冬梅、褚杏娟

本周一,马斯克在他的社交媒体平台 X 上宣布 xAI 开源 Grok,这也兑现了他上周的开源承诺。截至目前,Grok 已经在 GitHub 上获得了 4.3k 颗 Star。

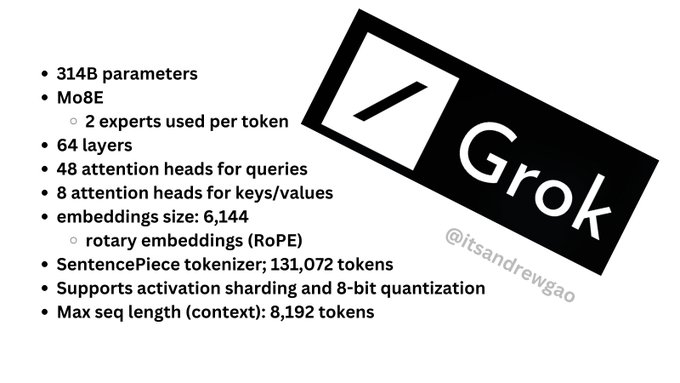

Grok-1 是一个由 xAI 从头训练的 3140 亿参数的混合专家模型,其中 25% 的权重来处理给定的标记。xAI 这次发布的是大型语言模型 Grok-1 的基本模型权重和网络架构,使用了 Apache-2.0 许可证。

根据介绍,Grok 的架构是在 2023 年 10 月使用自定义训练堆栈在 JAX 和 Rust 上开发的,采用了创新的神经网络设计方法。

“该版本是 Grok-1 预训练阶段的原始基本模型检查点,该阶段于 2023 年 10 月宣告结束。这意味着该模型并未针对任何一种特定的应用(比如对话和交谈)进行了微调。”xAI 在博文里说道。

Andrew Kean Gao 总结了 Grok-1 的模型情况如下:

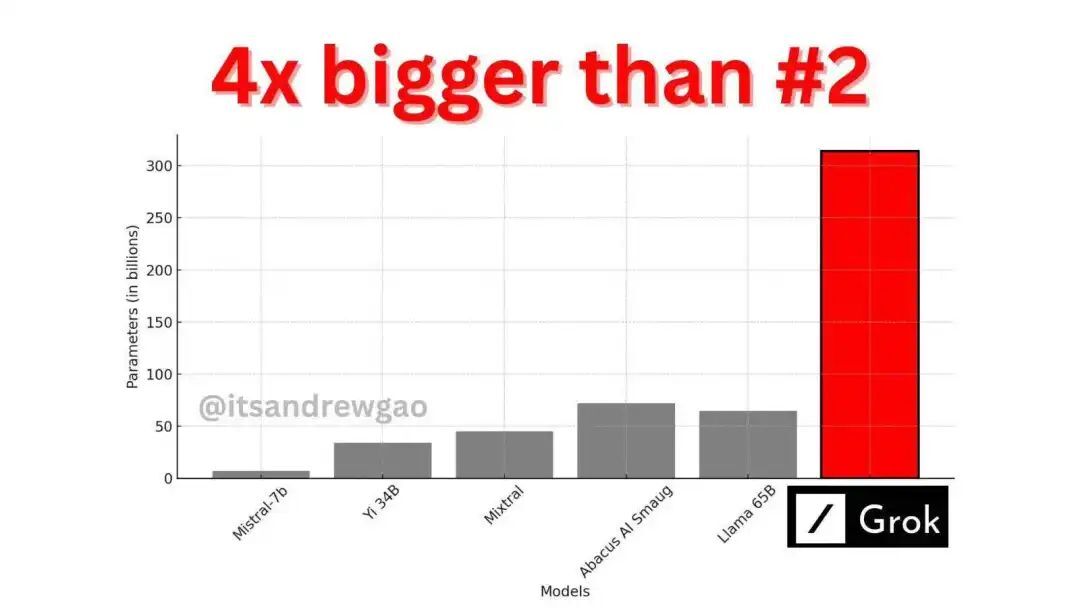

此外,他还将 Grok-1 与其他开源模型参数量进行了对比,Grok-1 是 Llama-65B 的 4 倍多。

相比之下,OpenAI 提供了 ChatGPT 的一个版本及其背后的语言模型供免费使用,但其源代码却是闭源的。

对此,英伟达高级科学家 Jim Fan 评价称,(这是)有史以来最大的开源大模型,由世界一流的团队训练。“我想知道被 Grok 超越是什么感觉。”“314B、混合专家 (2 / 8 有效)。即使仅活动参数 (86B) 就超过了最大的 Llama。迫不及待地想看到基准测试结果以及人们用它构建的东西。”另外,他还做了一下修正:Google 传统型号的 switch transformer 为 1.6T,目前保持着公开记录。

公开

同步至部落

取消

完成

0/2000

笔记

复制

AI

- 深入了解

- 翻译

- 解释

- 总结

马斯克宣布开源Grok,这一举动引发了广泛关注和争议。Grok是由xAI开发的3140亿参数的混合专家模型,已在GitHub上获得了4.3k颗Star。该模型基于创新的神经网络设计方法,使用了Apache-2.0许可证。与其他开源模型相比,Grok-1的规模超过Llama-65B的4倍多,成为全球最大的开源模型。马斯克此举被认为是为了激发人们对其公司人工智能的兴趣,并可能帮助xAI接触更多终端用户。然而,一些人担心开源人工智能模型可能带来风险,如虚假信息或生产化学或生物武器。尽管存在争议,Grok的开源将为外部人工智能专家提供测试机会,也将有助于xAI在AIGC市场获得更多吸引力。

该试读文章来自《AI 前线》,如需阅读全部文章,

请先领取课程

请先领取课程

免费领取

© 版权归极客邦科技所有,未经许可不得传播售卖。 页面已增加防盗追踪,如有侵权极客邦将依法追究其法律责任。

登录 后留言

精选留言

由作者筛选后的优质留言将会公开显示,欢迎踊跃留言。

收起评论