15|Transformer技术原理:为什么说Transformer是大模型架构的基石?(下)

独行

你好,我是独行。

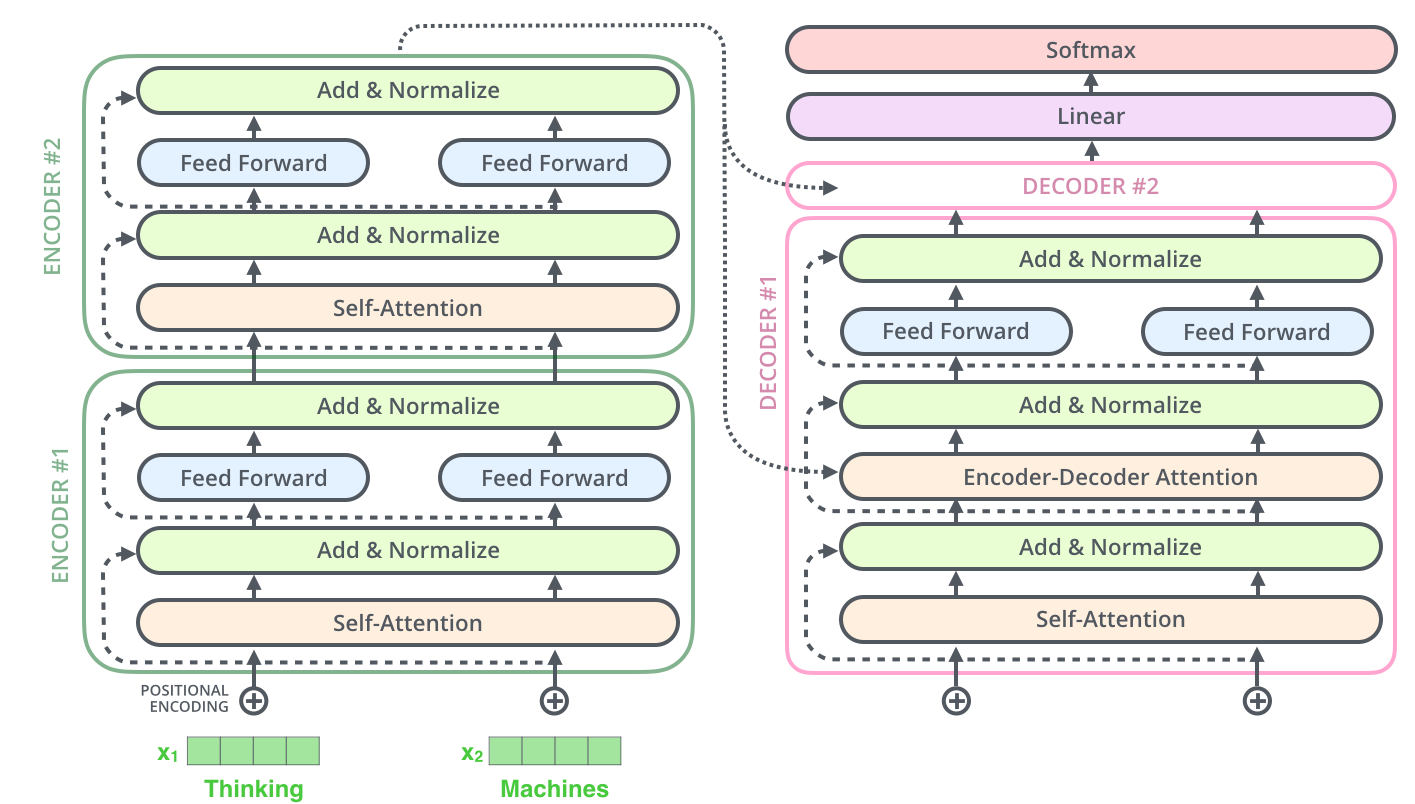

上一节课我们讲解了编码器各层的数据处理逻辑,这节课我们进入解码器。先来看一个更加细化的架构图,解码器多了一层:编码 - 解码注意力层(Encoder-Decoder Attention),我们依次来看一下。

图片来源于网络

Transformer 架构原理

自注意力层处理(解码器)

解码器的自注意力层设计得比较特别,与编码器的自注意力层不同,解码器的自注意力层需要处理额外的约束,即保证在生成序列的每一步仅依赖于之前的输出,而不是未来的输出。这是通过一个特定的掩蔽(masking)技术来实现的。接下来我详细解释一下解码器自注意力层的几个关键点。

处理序列依赖关系,解码器的自注意力层使每个输出位置可以依赖于到目前为止在目标序列中的所有先前位置。这允许模型在生成每个新词时,综合考虑已生成的序列的上下文信息。

掩蔽未来信息,为了确保在生成第 个词的时候不会使用到第 及之后的词的信息,自注意力层使用一个上三角掩蔽矩阵,在实现中通常填充为负无穷或非常大的负数。这保证了在计算 Softmax 时未来位置的贡献被归零,从而模型无法“看到”未来的输出。

动态调整注意力焦点,通过学习的注意力权重,模型可以动态地决定在生成每个词时应更多地关注目标序列中的哪些部分。

公开

同步至部落

取消

完成

0/2000

笔记

复制

AI

- 深入了解

- 翻译

- 解释

- 总结

1. 解码器的自注意力层通过特定的掩蔽技术来确保在生成序列的每一步仅依赖于之前的输出,而不是未来的输出。 2. 解码器的自注意力层使每个输出位置可以依赖于到目前为止在目标序列中的所有先前位置,允许模型在生成每个新词时,综合考虑已生成的序列的上下文信息。 3. 编码-解码注意力层用在解码器中,将解码器当前位置的查询向量与编码器的输出进行注意力计算,有助于解码器在生成输出序列时对输入序列的信息进行有效整合和利用。 4. Softmax函数的作用是将一组任意实数转换成一个概率分布,用于计算注意力分数和在解码器最后一层进行处理。 5. Softmax函数的计算有助于模型更明确地选择输入的部分,规范化数据并使模型行为更透明,有助于调试和优化模型。 6. Softmax转换后的概率值反映了输入值相对于其他值的重要性,使模型可以做出更精确的决策,适合进一步的处理和决策。 7. Transformer模型通过自注意力机制实现了并行处理能力,捕捉长距离依赖关系,灵活的注意力分布和可扩展性,提供了显著的优势。 8. Transformer模型中的哪一个部分最可能对抓取关键信息并生成准确摘要起到决定性作用,以及如何简单调整模型来确保关键信息被捕捉,是需要思考的问题。

仅可试看部分内容,如需阅读全部内容,请付费购买文章所属专栏

《AI 大模型实战高手课》,新⼈⾸单¥59

《AI 大模型实战高手课》,新⼈⾸单¥59

立即购买

© 版权归极客邦科技所有,未经许可不得传播售卖。 页面已增加防盗追踪,如有侵权极客邦将依法追究其法律责任。

登录 后留言

精选留言

由作者筛选后的优质留言将会公开显示,欢迎踊跃留言。

收起评论