02|学习小助手:基于企业私有数据构建聊天机器人

王吕

本门课程为精品小课,不标配音频

你好,我是王吕,欢迎你跟我一起来学习大模型 LLM & RAG 快速应用。今天我准备给你介绍一下极客时间小助手的开发细节和考量,希望能解答你在大模型对话系统开发过程中的问题。

极客时间小助手是一个基于 RAG 技术的对话问答应用,他的特点就是使用了极客时间课程内容作为知识库,利用讲师专家的经验作为背书,提供更好的技术类问答能力。入口在这里:https://aibot.geekbang.org

这是一个标准的 RAG 应用场景,下面我们从需求到技术仔细聊聊。

需求设计

我们开发小助手的核心目的是使用大模型技术帮助用户解答编程问题,其次是通过用户问题,找到用户可能感兴趣的内容,推荐给用户。

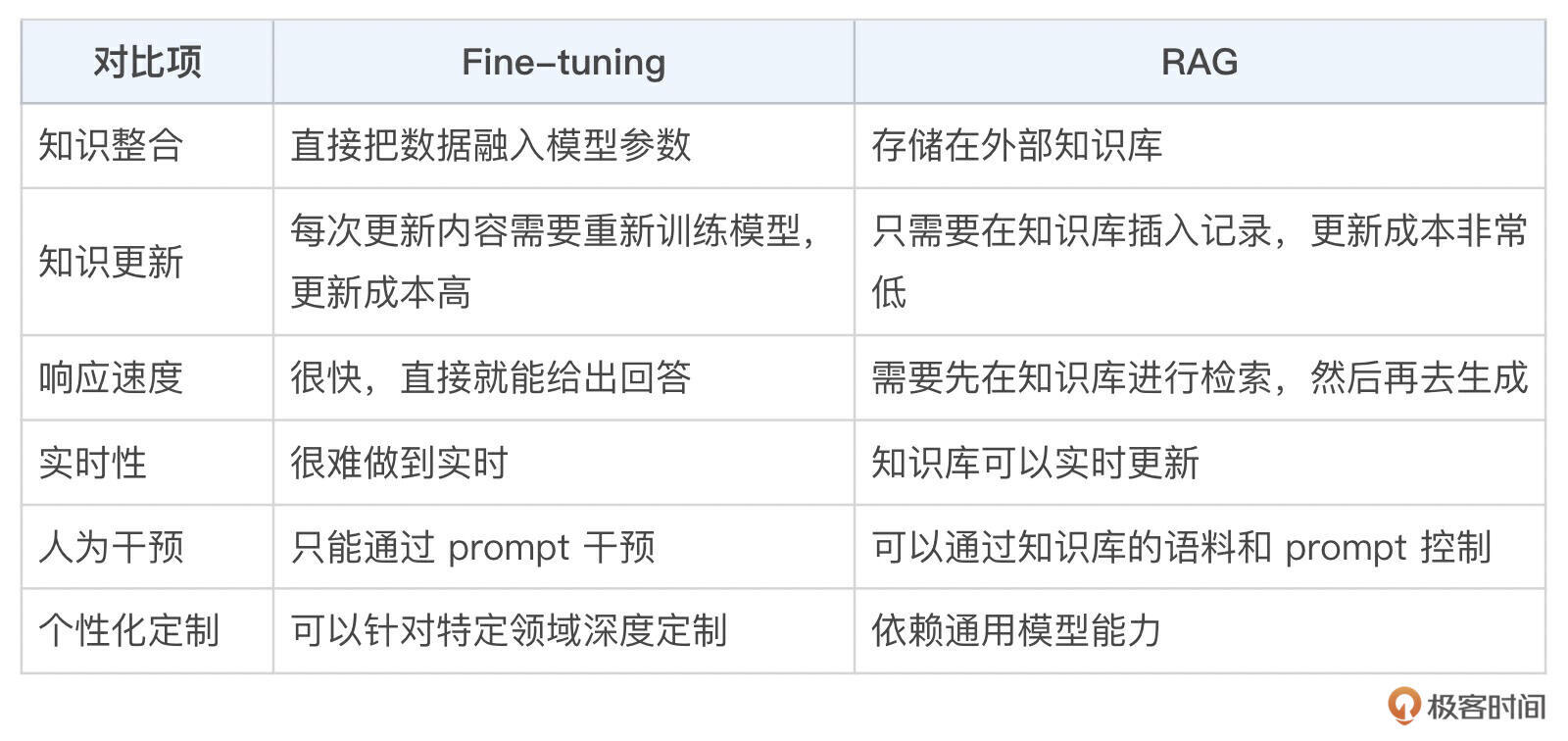

目的已经明确了,我们开始一步一步思考实现。既然要让大模型使用极客时间的知识库回答用户问题,那么就要把我们的知识资料输入给大模型,目前主要是两种方式,Fine-tuning 和 RAG,以下是两种技术的对比。

我们对小助手的要求是,要能实时更新知识资料,不需要模型去深度探讨问题,重点使用我们的知识经验去解答用户问题。基于此,我们选择了 RAG 技术作为技术方案。

这里你可能会想,那什么时候使用 Fine-tuning 合适呢?

公开

同步至部落

取消

完成

0/2000

笔记

复制

AI

- 深入了解

- 翻译

- 解释

- 总结

1. 极客时间小助手是基于 RAG 技术的对话问答应用,利用极客时间课程内容作为知识库,提供技术类问答能力。 2. 构建小助手的核心目的是使用大模型技术帮助用户解答编程问题,并通过用户问题找到可能感兴趣的内容进行推荐。 3. 选择RAG技术方案是因为要实时更新知识资料,重点使用知识经验解答用户问题,而Fine-tuning适用于特定场景下高一致性和定制化、数据量充足稳定、强个性化需求和高速响应的情况。 4. 构建知识库的关键在于如何切割文档,采用了按长度切割和按换行切割的结合方案,并解决了截断问题和语义分割的选择。 5. 对话应用的结构包含大模型服务和对话应用服务,其中大模型服务包含了模型处理和知识库处理功能,对外输出统一的接口能力。 6. 大模型服务系统中接入了5家大模型,定义了一个接口,封装各家模型,实现了请求参数控制使用哪家模型,并接入了统一风控,保证数据合法合规。

仅可试看部分内容,如需阅读全部内容,请付费购买文章所属专栏

《LLM & RAG 快速应用小册》

《LLM & RAG 快速应用小册》

立即购买

© 版权归极客邦科技所有,未经许可不得传播售卖。 页面已增加防盗追踪,如有侵权极客邦将依法追究其法律责任。

登录 后留言

精选留言

由作者筛选后的优质留言将会公开显示,欢迎踊跃留言。

收起评论